A Inteligência Artificial (IA) já está integrada no nosso dia-a-dia e ganha cada vez mais espaço à medida que traz ferramentas capazes de facilitar tarefas do nosso cotidiano.

Na radiologia não é diferente, e sendo assim, a inteligência artificial já é uma realidade na área, ganhando cada vez mais importância por sua capacidade de organizar a fila de exames, agilizar a emissão de laudos e auxiliar no diagnóstico de um paciente.

Apesar dos benefícios, a exponencial inserção da inteligência artificial na radiologia instiga um receio recorrente – desde a Primeira Revolução Industrial no século XVIII – quando o assunto é novas tecnologias e trabalho: a substituição das pessoas pelas máquinas e a consequente redução do número de empregos nesta área.

Mas afinal, o que é a IA? Quais suas aplicações na radiologia? E como será a integração com os profissionais da área?

O que é Inteligência Artificial?

O conceito de inteligência artificial se refere à capacidade das máquinas de “pensar” como seres humanos. Ou seja, o poder de aprender, perceber, deliberar e decidir de forma racional e assertiva.

E este não é um conceito novo. Em meados de 1950, John McCarthy, um professor universitário, criou o termo para descrever um mundo em que as máquinas poderiam “resolver os tipos de problemas que hoje são reservados para humanos.”

Desde então os computadores começaram a ganhar visibilidade, e a tecnologia vem se tornando cada vez mais presente.

Nos smartphones, por exemplo, o corretor ortográfico, a assistente pessoal e muitos outros aplicativos funcionam com base na IA.

Os atendimentos iniciais em serviços online são predominantemente realizados por robôs de chat.

As recomendações de séries, filmes e vídeos em plataformas de streaming. O próximo post que aparece na sua rede social. Lâmpadas, câmeras de segurança, televisões e aspiradores de pó inteligentes.

A verdade é que já estamos muito familiarizados com muitos dispositivos de IA, que são inclusive essenciais para o funcionamento do mundo como conhecemos hoje.

Para atingir esse patamar de relevância, foi necessário um processo de evolução da inteligência artificial que passa por áreas como Machine Learning (aprendizagem de máquina), Deep Learning (aprendizagem profunda) e Processamento de Linguagem Natural.

A integração desses conceitos apontam para um futuro – já bastante atual – em que nossas plataformas e sistemas terão inteligência suficiente para aprender com nossas interações e com nossos dados, tornando-se independentes.

O que é machine learning?

O machine learning refere-se à capacidade de identificar padrões e criar conexões a partir de algoritmos e big data (grandes conjuntos de dados). Dessa forma, a máquina aprende a executar uma tarefa de forma automática, ou seja, sem a ajuda humana.

Todo o aprendizado automático é IA, mas nem toda IA conta com o aprendizado automático. As primeiras tecnologias de IA ficavam limitadas a reconhecer os padrões inseridos pelo programador.

Contudo, o aprendizado de máquina é o principal impulsionador da inteligência artificial, à medida que permite extrapolar o conjunto de dados que um humano pode processar e consequentemente os padrões que pode reconhecer.

O que é deep learning?

O deep learning é um conjunto de algoritmos complexos criados para “imitar” a rede neural do cérebro humano.

De maneira simplificada, seria como aliar as informações produzidas por dezenas ou centenas de computadores – cada um dotado com machine learning e especializado em sub-tarefas – a fim de executar uma tarefa específica.

Digamos que se queira identificar se uma imagem é um carro ou não.

Pense em todos os parâmetros que são passíveis de análise para se chegar a essa conclusão: silhueta do produto, presença ou não de pneus, número de pneus, tamanho dos pneus, quantidade de portas, altura do objeto, material utilizado, cor…

Dessa forma, é possível segmentar a capacidade de reconhecer um carro em milhares de pequenas análises.

No deep learning essas análises são realizadas por diferentes conjuntos de processadores, com diferentes algoritmos, para que no final, juntando-se todas as informações extraídas, se tenha a resposta à pergunta inicial.

O que é processamento de linguagem natural?

O processamento de linguagem natural utiliza as técnicas de machine learning para encontrar padrões em grandes conjuntos de dados puros e reconhecer a linguagem natural dos seres humanos (fala, escrita, expressões corporais).

O objetivo é que os computadores desenvolvam a capacidade de transcrever áudios e vídeos (bem como o caminho inverso, transformando textos em áudios e vídeos); criar textos e resumos; traduzir áudios e textos; interpretar sentimentos a partir de um texto, fala ou expressão corporal.

Um dos exemplos dessa aplicação é a análise de sentimento em redes sociais, utilizada por empresas para compreender como os clientes se sentem em relação a marcas e produtos específicos.

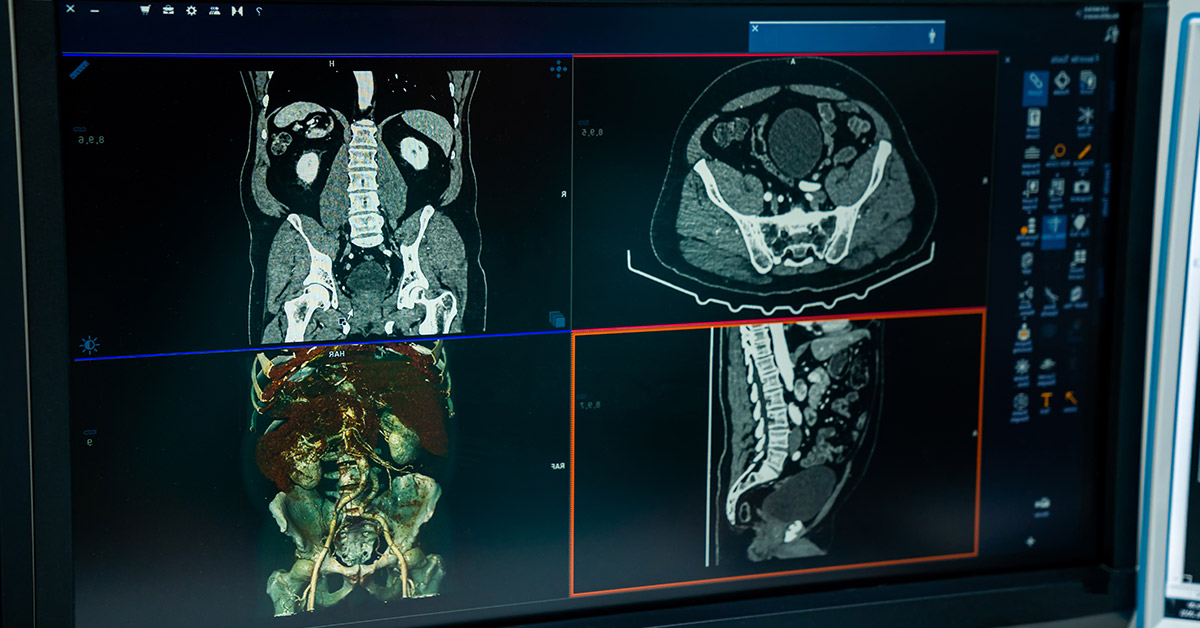

Como é aplicada a Inteligência Artificial na Radiologia

A inteligência artificial na radiologia pode ser explicada em 3 abordagens:

- análise pré-radiologista;

- abordagem de segmentação automática;

- abordagem substitutiva.

Análise pré-radiologista

A abordagem garante a organização de fila de trabalho, ou seja, define prioridades a partir do estado do paciente.

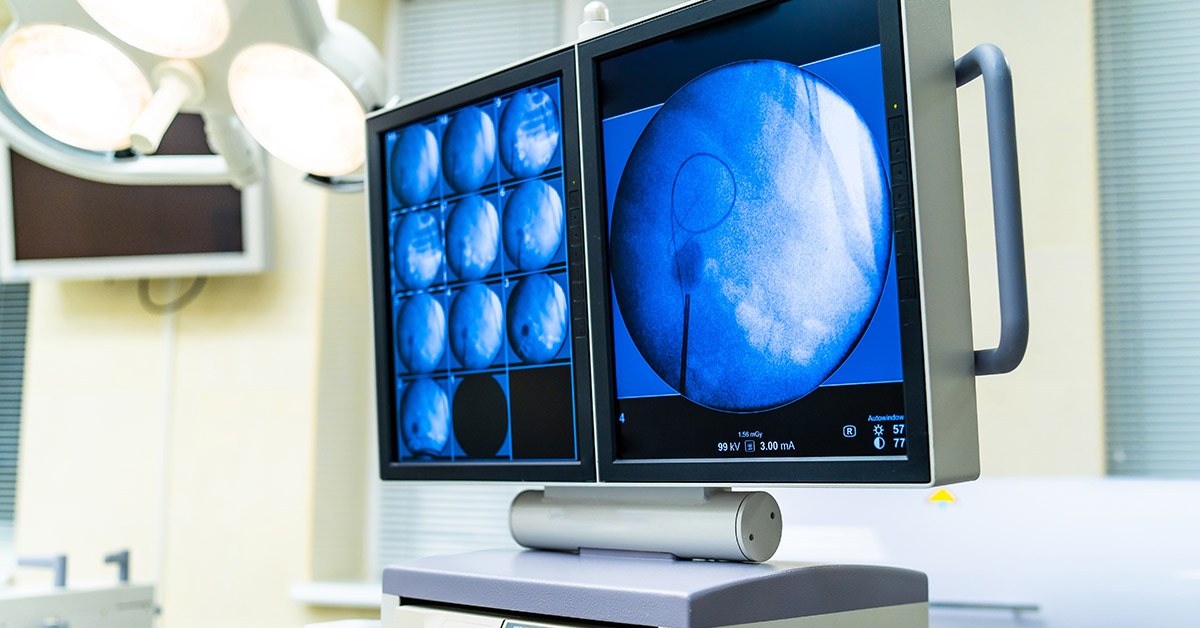

A máquina analisa a imagem antes do radiologista e verifica a urgência. Se o caso for uma emergência, como um AVC por exemplo, o exame estará no topo da fila de trabalho do radiologista, para que ele o priorize.

Essa tecnologia resulta em melhoria de fluxo e otimização dentro dos centros de imagem.

Abordagem de segmentação automática

Ferramentas que complementam e agilizam o trabalho do especialista.

Faz uma análise quantitativa das imagens, deixando a análise qualitativa para o radiologista.

Alguns exemplos que já são utilizados na prática são a reconstrução de imagens, o cálculo de volume de diversas estruturas e a mensuração de placas de cálcio nas artérias coronárias em exames de tomografia de tórax.

Abordagem substitutiva

É a fase de abordagem que se encontra mais distante da realidade, seja pelas limitações técnicas, seja pelas implicações éticas.

Nessa etapa, a máquina faria todo o processo, desde organização de fila de trabalho até o diagnóstico final.

Para que um sistema de inteligência artificial na radiologia seja implementado em um centro de imagem, é necessário que ele seja aprovado pela FDA (Food and Drug Administration), nos Estados Unidos, ou pela Anvisa (Agência Nacional de Vigilância Sanitária), no Brasil.

Alguns sistemas com características específicas já foram aprovados nos Estados Unidos e se encaminham para a aprovação da Anvisa. Como:

- Organização de fila baseado em emergência radiológica;

- Avaliação de densidade óssea baseada em estudos de tomografia;

- Avaliação de AVC;

- Pós-processamento automatizado de perfusão;

- Volumetria de ventrículo em ressonância magnética;

- Segmentação de volume cerebral;

- Análise automatizada de radiografia e tomografia de tórax.

Quais os benefícios do uso da inteligência artificial na radiologia?

Da mesma maneira que a inserção da inteligência artificial em outros campos trouxe imensuráveis benefícios aos profissionais da área e aos clientes, na radiologia não seria diferente E hoje é possível perceber os resultados, tais como:

- Melhoria de fluxo, priorizando emergências e urgências;

- Diminuição do tempo de entrega do laudo;

- Maior assertividade dos laudos;

- Aprimoramento de informações relevantes;

A inteligência artificial na radiologia pode substituir os profissionais?

Este é um assunto bem comum no cenário acadêmico, com muitos artigos sendo escritos sobre a substituição de radiologistas pela inteligência artificial.

Apesar de muitos especularem sobre a extinção da profissão, o cenário mais provável é de que radiologistas se adaptem às novas tecnologias, explorando cada vez mais e melhor os recursos que elas podem oferecer.

Em um artigo publicado na revista Radiology: Artificial Inteligence, Langlotz relata como a história é cheia de momentos quando a especialidade estava supostamente ameaçada.

Muitos pensavam que a tecnologia de ressonância magnética iria substituir radiologistas, por exemplo.

Isso porque acreditava-se que os médicos solicitantes iriam imediatamente saber tudo o que precisavam apenas vendo as imagens, sem explicações adicionais necessárias.

No entanto, o que realmente aconteceu foi que os radiologistas acabaram aprendendo muito mais sobre o método, suas limitações e como interpretá-lo.

Uma repetição da mesma sequência de eventos está acontecendo agora, com radiologistas liderando na Inteligência Artificial e mais uma vez demonstrando que a especialidade pode se sobressair e virar a mesa.

Conclusão

Uma das melhores metáforas para como a inteligência artificial vai transformar a Radiologia, ainda de acordo com Langlotz, é como o piloto automático impactou os pilotos de aviões.

O piloto pode acionar a inteligência artificial dentro do cockpit, permitindo que ela cuide de tarefas repetitivas. Porém, e se o sistema possuir algum tipo de problema ou defeito? Ou se existir uma tempestade no horizonte?

O piloto está lá de prontidão, disponível para assumir o comando quando necessário. Pronto para aliar seu julgamento, criatividade e empatia aos computadores para resolver o problema.

Perguntas frequentes

Como funciona a inteligência artificial na radiologia?

A inteligência artificial na radiologia pode ser explicada em 3 abordagens: análise pré-radiologista, abordagem de segmentação automática e abordagem substitutiva.

Qual futuro da inteligência artificial na radiologia?

Segundo Langlotz, a inteligência artificial está destinada a mudar profundamente a prática da radiologia. Mas certamente de uma forma em que ainda haverá a necessidade de se ter radiologistas - que saibam utilizar essas novas ferramentas.